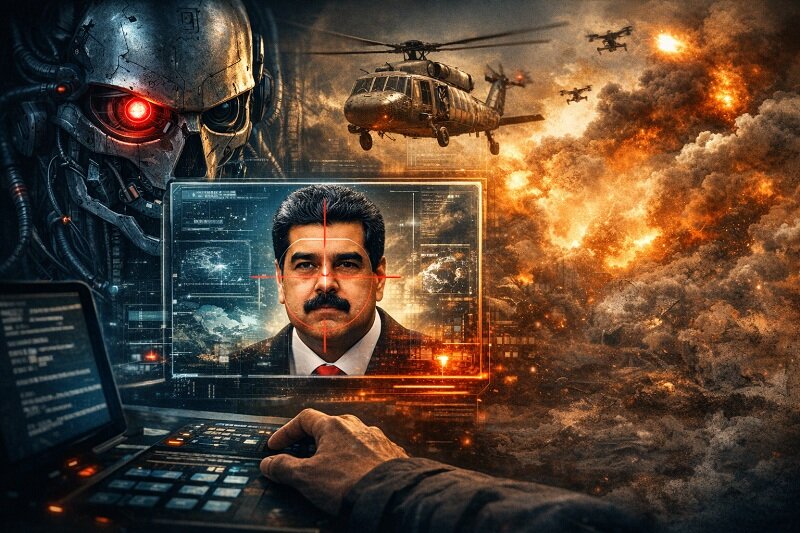

به گزارش آفتاب نو، خبرهایی که اخیرا درباره رد پای هوش مصنوعی شرکت آنتروپیک در عملیات علیه نیکلاس مادورو، رئیسجمهور ونزوئلا منتشر شده، صرفنظر از صحت یا عدم صحت کامل آن، زنگ خطری جدی درباره آینده جنگ و قدرتطلبی است. این ماجرا تنها یک خبر سیاسی یا حوزه فناوریهای نوین نیست؛ بلکه نشانهای از تغییر ماهیت جنگها در عصر فناوری است.

نقطهای که نگرانیها را تشدید کرد

بر اساس گزارش برخی رسانهها از جمله روزنامه والاستریت ژورنال، در عملیات آمریکا علیه نیکلاس مادورو، از مدل هوش مصنوعی «Claude» متعلق به شرکت آنتروپیک برای تحلیل اطلاعات یا پشتیبانی عملیاتی استفاده شده است. هرچند جزئیات این ادعا تأیید رسمی نشده و نقش دقیق این فناوری مشخص نیست، اما همین احتمال، موجی از نگرانیهای اخلاقی و امنیتی را برانگیخته است. اگر چنین ادعایی درست باشد، این نخستین نمونه از استفاده عملی یک مدل هوش مصنوعی تجاری در عملیات حساس نظامی یا امنیتی خواهد بود؛ اتفاقی که مرز میان فناوری غیرنظامی و ابزار جنگی را بیش از پیش محو میکند. حتی اگر این گزارشها اغراقآمیز یا ناقص باشند، طرح چنین سناریویی نشان میدهد که جهان تا چه اندازه به پذیرش این تحول نزدیک شده است.

خطر واگذاری تصمیمهای مرگ و زندگی به ماشینها

مخالفان نظامیسازی هوش مصنوعی هشدار میدهند که بزرگترین خطر، صرفاً قدرت این فناوری نیست، بلکه انتقال تدریجی اختیار تصمیمگیری از انسان به سیستمهای غیرانسانی است. وقتی تحلیلهای الگوریتمی مبنای تصمیمهای نظامی شوند، فاصله میان تصمیم و پیامد انسانی آن بهشدت افزایش مییابد. جنگ به یک مسئله فنی تبدیل میشود، نه اخلاقی.

هوش مصنوعی:

– مسئولیت اخلاقی ندارد

– درک انسانی از پیامدهای خشونت ندارد

– نمیتواند ارزش جان انسان را بفهمد

– پاسخگو نیست (البته سردمداران کاخ سفید هم پاسخگو نیستند)

خصوصیسازی جنگ

ورود شرکتهای فناوری به حوزه نظامی، به معنای انتقال بخشی از قدرت جنگ از دولتها به شرکتهای خصوصی است. شرکتهایی که:

– در برابر افکار عمومی پاسخگو نیستند

– تصمیمهایشان شفاف نیست

– انگیزههای اقتصادی دارند

مسیر خطرناک عادیسازی

شاید بزرگترین نگرانی این باشد که استفاده از هوش مصنوعی در عملیات نظامی بهتدریج عادی شود. همانگونه که پهپادها ابتدا بحثبرانگیز بودند اما امروز به ابزار رایج جنگ تبدیل شدهاند، هوش مصنوعی نیز میتواند بدون بحث عمومی جدی وارد ساختار نظامی جهان شود. خبرهایی مانند ماجرای مادورو (حتی در حد ادعا) بخشی از این روند عادیسازی را نشان میدهد.

آیندهای که باید درباره آن تصمیم گرفت

مسئله اصلی فناوری نیست؛ مسئله نحوه استفاده از آن است. هوش مصنوعی میتواند در پزشکی، آموزش، محیط زیست و حل بحرانهای جهانی نقش حیاتی ایفا کند. اما تبدیل آن به ابزار جنگی، آیندهای را رقم میزند که در آن تصمیمهای حیاتی درباره انسانها توسط سیستمهایی گرفته میشود که نه وجدان دارند و نه مسئولیت.

ارسال نظر شما

مجموع نظرات : 0 در انتظار بررسی : 0 انتشار یافته : 0